ElevenLabs Review - Wie KI Sprachbarrieren mühelos überwindet!

Hast du dir schon mal vorgestellt, wie es wäre, wenn du über Nacht alle Sprachen sprechen könntest? Das ist kein Traum mehr - es ist Realität! Der KI-Sprachgenerator ElevenLabs macht es möglich. In unserem Artikel erfährst du alles, was du zu ElevenLabs wissen musst.

ElevenLabs* ist eine Plattform, die fortschrittliche KI nutzt, um realistische Sprache zu erzeugen. Und ja, sie klingt wirklich sehr realistisch!

In diesem Artikel schauen wir uns die Funktionen “Sprachsynthese” (engl. Speech Synthesis) und “Sprachsynchronisation” (engl. Dubbing) an.

Mit der Funktion Sprachsynthese kannst du aus einem Text realistische Audiospuren in einer Vielzahl von Sprachen erstellen.

Mit der Sprachsynchronisation Funktionalität kannst du Sprachbarrieren mühelos überwinden. Stell dir vor, du könntest die Audiospuren deiner Videos in jede beliebige Sprache der Welt synchronisieren. Genau das kannst du mit dieser Funktion tun.

Wir stellen dir die grundlegenden Funktionen von ElevenLabs* anhand von praktischen Beispielen vor. Am Ende des Artikels bist du davon überzeugt, dass KI deine Inhalte auf ein neues Level heben kann!

ElevenLabs kostenlos testen

Wenn du ElevenLabs kostenlos testen möchtest, dann kannst du das über folgenden Link tun:

Du erhältst folgende Vorteile:

- ~10 Audio-Minuten pro Monat kostenlos

- Übersetzungen in bis zu 29 Sprachen möglich

- Erstellung von eigenen synthetischen Stimmen

- Zugriff auf die ElevenLabs API

Sprachsynthese

Text zu Sprache

Diese Funktion wandelt Text in realistische Sprache mit einer Stimme deiner Wahl um. Du kannst aus einer Reihe von vorgefertigten Stimmen wählen oder eine eigene Stimme erzeugen.

Es gibt verschiedene Optionen, um eine eigene Stimme zu erstellen. Du kannst eine neue Stimme entwerfen, indem du verschiedene Stimmparameter einstellen kannst. Jede erzeugte Stimme ist einzigartig und völlig zufällig, selbst wenn du die Einstellungen identisch wählst.

Darüber hinaus hast du die Möglichkeit, deine eigene Stimme aus einer Audio-Aufnahme zu klonen. Die Audio-Aufnahme darf nur einen einzigen Sprecher enthalten und muss länger als 1 Minute dauern. Außerdem sollte die Aufnahme möglichst frei von Hintergrundgeräuschen sein. Diese Möglichkeit ist allerdings erst im Starter Abo verfügbar. Die aktuellen Preise findest du auf der Website von ElevenLabs*.

Eine weitere Möglichkeit ist es, eine Stimme aus der Community-Bibliothek (Voice Library) auszuwählen. In der Community-Bibliothek gibt es auch deutsche Stimmen.

In diesem Artikel wollen wir uns allerdings eine eigene synthetische Stimme erstellen. Aus diesem Grund wählen wir die Option “Voice Design”. Die Konfiguration einer eigenen Stimme ist kinderleicht.

ElevenLabs* steht aktuell leider nur in englischer Sprache zur Verfügung. Mit unserem Guide solltest du aber keine Probleme haben das Tool zu bedienen! Egal, ob du fit in Englisch bist oder nicht!

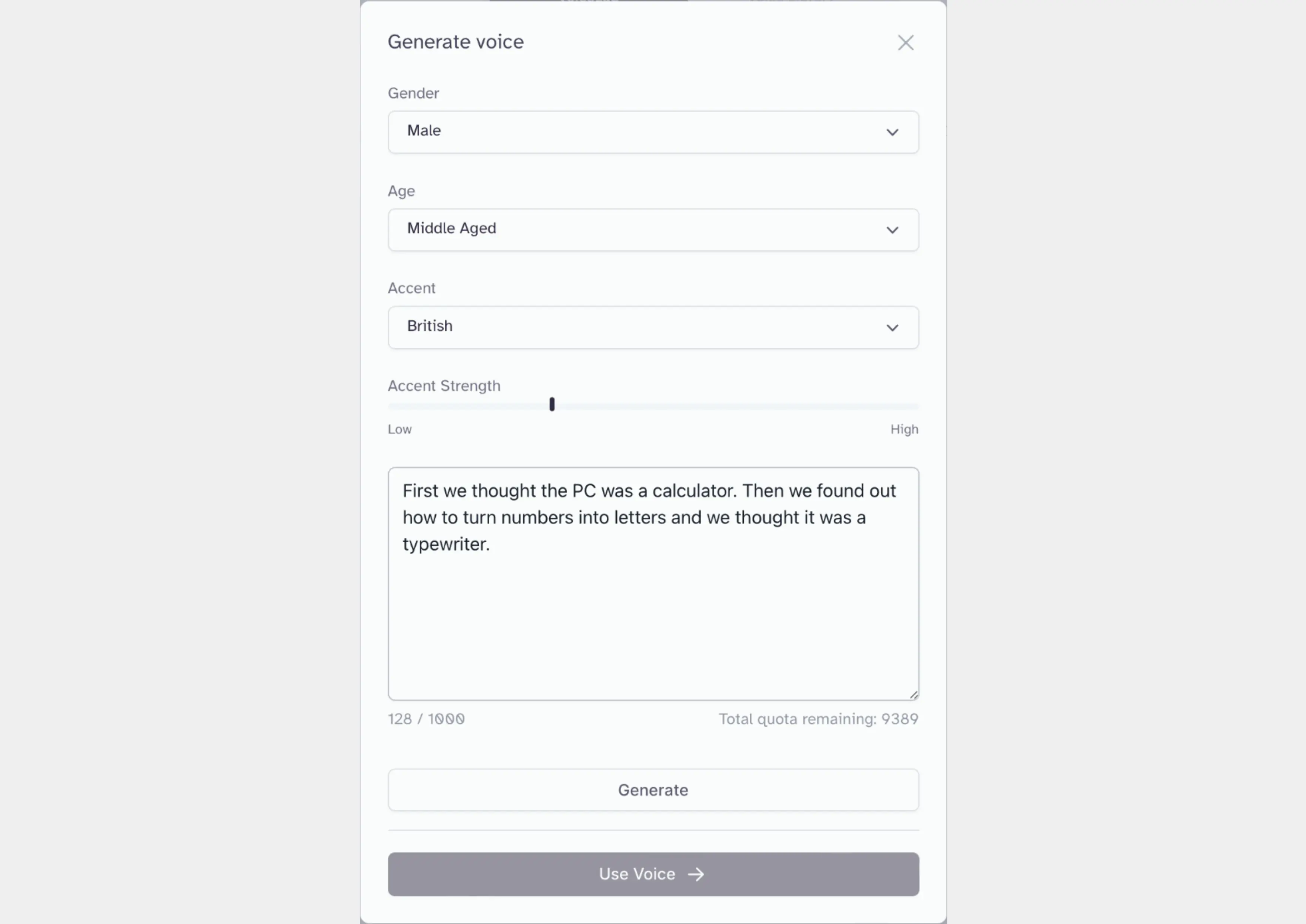

Im Voice Designer hast du die folgenden Einstellungsmöglichkeiten:

Zunächst kannst du wählen, ob die Stimme männlich oder weiblich sein soll. Dann kannst du das ungefähre Alter der Stimme wählen (jung, mittelalt, alt). Außerdem kannst du den Akzent wählen (amerikanisch, britisch, afrikanisch, australisch, indisch) und wie stark der Akzent ausgeprägt sein soll.

Aktuell ist es leider nicht möglich andere Akzente auszuwählen. Du kannst aber die Akzent Stärke reduzieren, wodurch der Akzent bei der Stimme fast vollständig verschwindet!

Dann gibst du einen Beispieltext ein, den die KI-Stimme als Hörprobe verwenden soll.

Nachdem du alle Einstellungen vorgenommen hast, kannst du auf “Generate” klicken. Daraufhin generiert das Tool eine Stimme auf der Grundlage deiner Einstellungen. Wenn du mit der Stimme zufrieden bist, kannst du auf “Use Voice” klicken.

Anschließend kannst du der Stimme noch einen Namen und eine Beschreibung geben.

Als nächstes kannst du die erzeugte Stimme verwenden, um aus einem Text eine Audiospur zu produzieren. Schauen wir uns das mal genauer an.

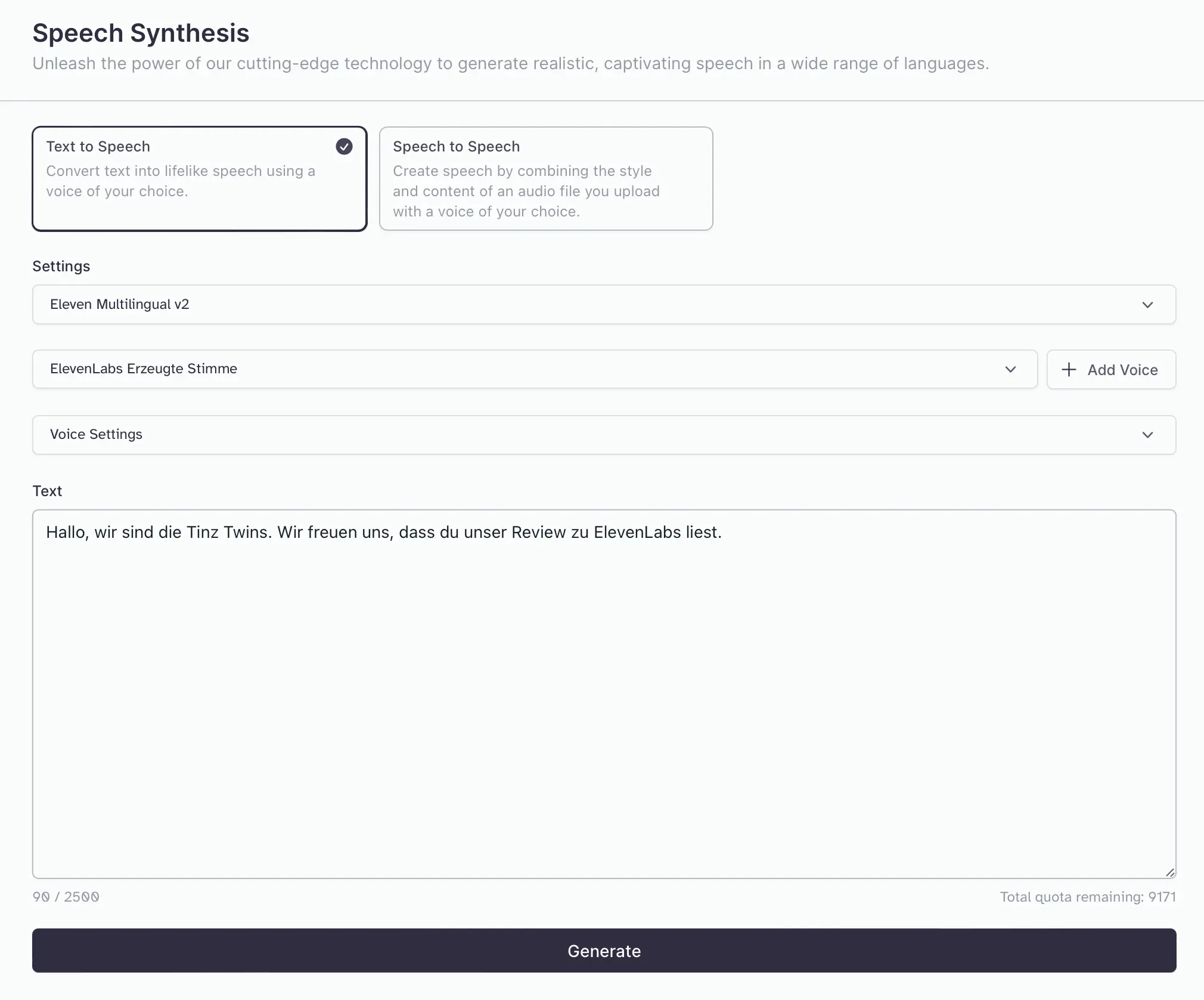

Zunächst wählst du die Option “Text to Speech” aus. Unter dem Abschnitt “Settings” kannst du das KI-Modell auswählen. Im Screenshot haben wir uns für das Modell “Eleven Multilingual v2” entschieden. Dieses Modell unterstützt 29 Sprachen.

Als nächstes kannst du aus verschiedenen Stimmen wählen. An dieser Stelle kannst du die generierte Stimme aus dem vorherigen Abschnitt auswählen.

Unter dem Punkt “Voice Settings” kannst du festlegen, wie stabil und klar die Stimme sein soll. Am besten spielst du damit ein bisschen herum.

Zum Schluss gibst du einen Text in einer beliebigen Sprache ein und klickst auf “Generate”. Das Modell erzeugt eine Audiodatei mit der ausgewählten Stimme.

Du kannst die Audiodatei dann herunterladen. Diese Funktionalität ist zum Beispiel sehr praktisch, wenn du deine Video Skripte in mehrsprachige Audiospuren übersetzen möchtest. Im Ergebnis erhältst du eine Audiospur, die du in deinen Videos verwenden kannst.

Im Folgenden kannst du dir die Stimme (Männlich, mittleres Alter, Geringer Britischer Akzent) mit dem Beispieltext von oben anhören.

Viele Blogger nutzen ElevenLabs auch, um ihren Lesern ihre Blog Artikel als Audio zur Verfügung zu stellen. So können die Leser die Blog Artikel auch als Podcast anhören!

Und das Beste daran ist, dass das für alle unterstützten Sprachen funktioniert! Sprachbarrieren gehören ab sofort der Vergangenheit an.

Als nächstes schauen wir uns die Funktion “Speech to Speech” an.

Sprache zu Sprache

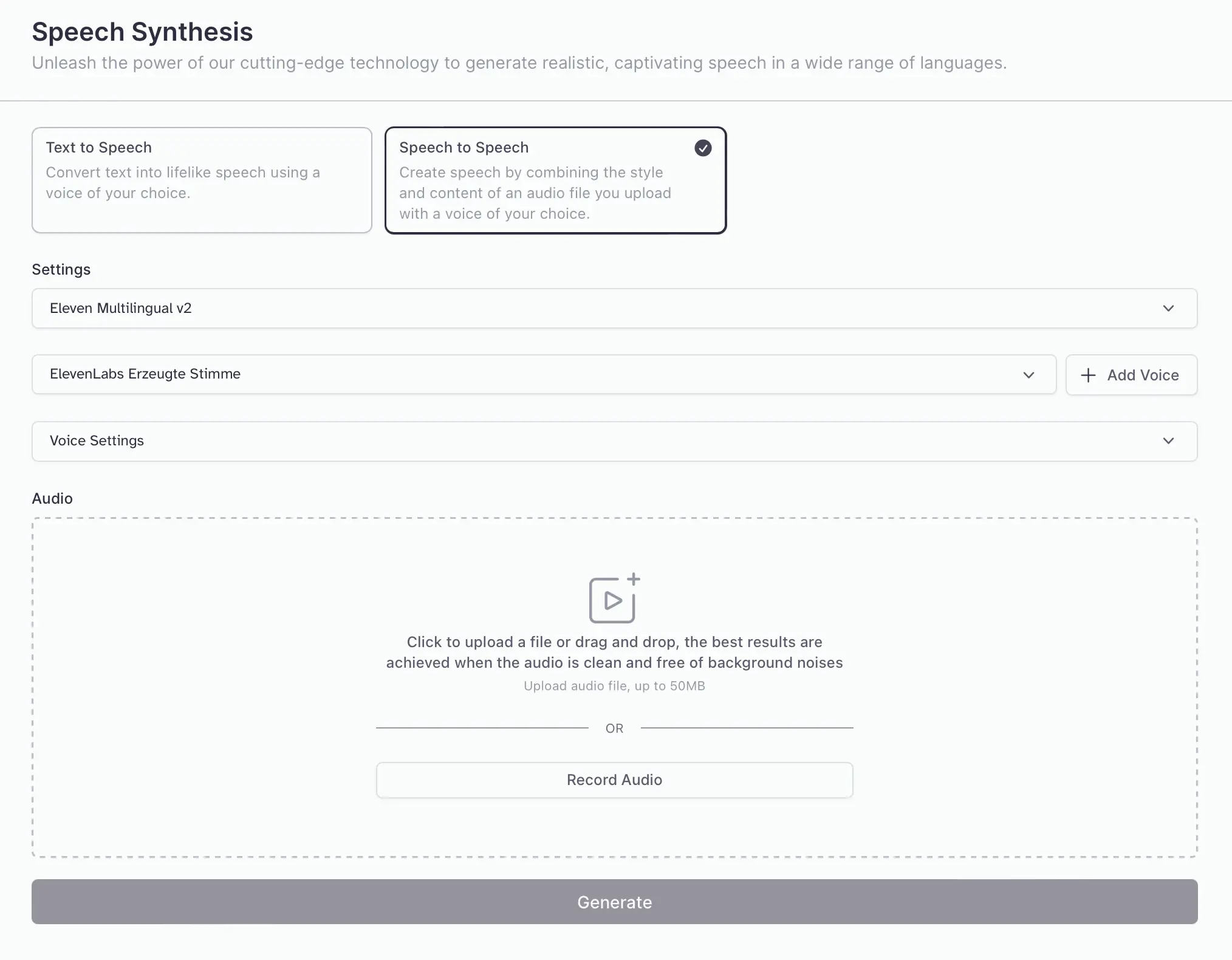

Die Funktion “Speech to Speech” funktioniert ähnlich wie die Funktion “Text to Speech”. Anstatt Text einzugeben, lädst du eine Audiodatei hoch.

Du kannst eine Stimme auswählen, die für die neue Audiodatei verwendet werden soll. Als Modell kannst du wieder das mehrsprachige Modell “Eleven Multilingual v2” wählen.

Das Modell erstellt dann eine neue Audiodatei, indem es sich an der Sprechart der originalen Stimme orientiert. Mit dieser Funktionalität kannst du deine vorhandenen Audiospuren in bis zu 29 Sprachen synchronisieren.

Im Folgenden siehst du die Benutzeroberfläche für die Funktion “Speech to Speech”.

Die Sprachsynthese Funktionen “Text to Speech” und “Speech to Speech” funktioniert sehr gut. Wir sind erstaunt, wie menschenähnlich die Stimmen klingen. Am besten probierst du die Sprachsynthese Funktionen auf der Website von ElevenLabs* einfach mal aus.

Im nächsten Abschnitt schauen wir uns eine Funktion an, mit der du deine Videos in eine Vielzahl von Sprachen übersetzen kannst.

Dubbing

Die Funktion “Dubbing” hat uns wirklich sehr beeindruckt! Mit dieser Funktion kannst du die Audiospuren deiner Videos in fast jede beliebige Sprache übersetzen.

Lass uns diese Funktionalität gemeinsam anschauen.

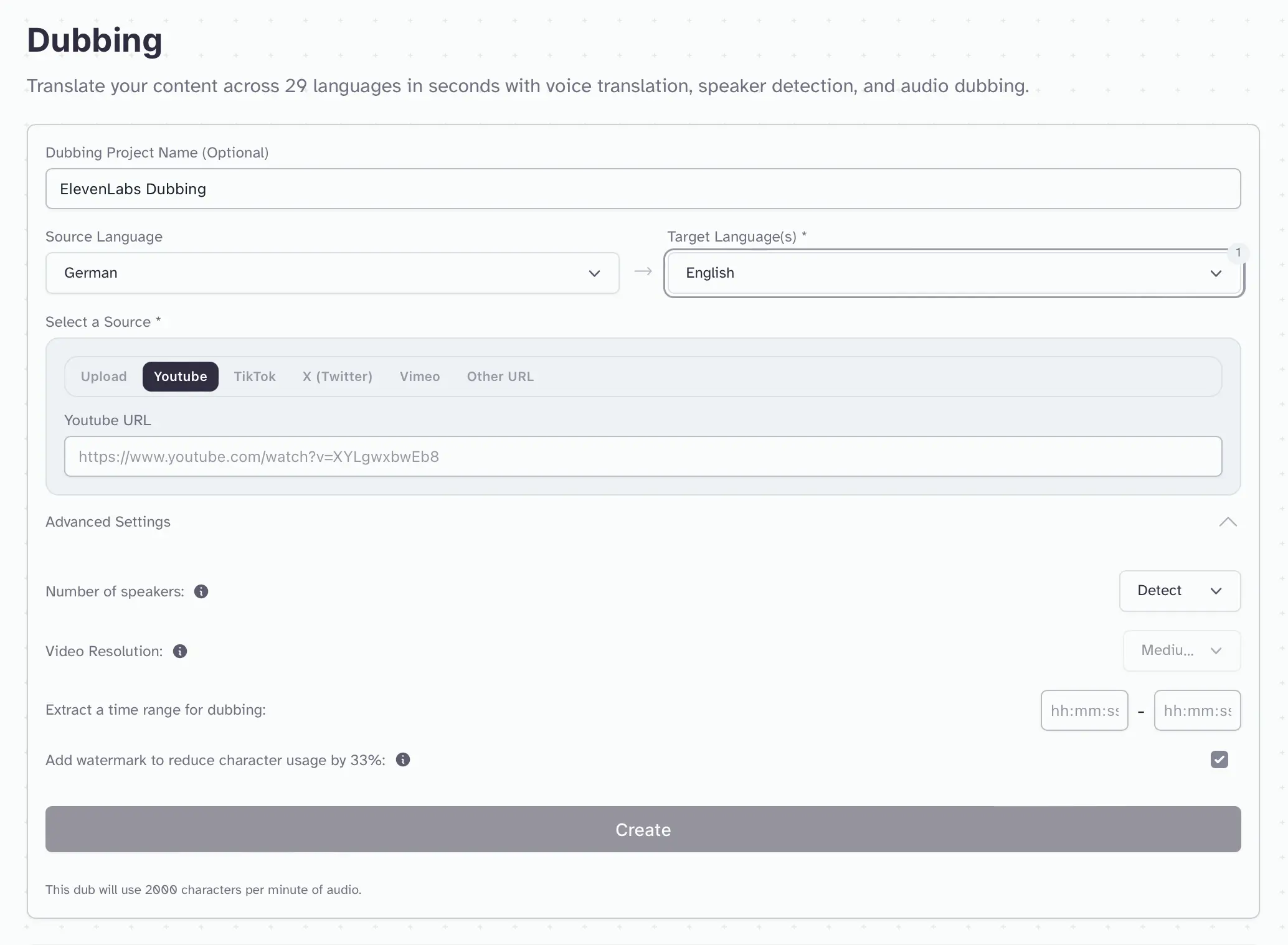

Zunächst kannst du dem Projekt einen Namen geben. Dann kannst du die Ausgangssprache und die Zielsprache auswählen. Anschließend kannst du deine Video oder Audio Datei hochladen oder einen Link angeben.

Wir haben die Funktion mit einem unserer YouTube-Videos getestet. In diesem Video sprechen wir über unser Tesla Investment auf Deutsch. Hier ist die originale Audiospur unseres Videos:

Dann haben wir das Video mithilfe von ElevenLabs ins Englische synchronisiert. Hier ist das Ergebnis:

Beeindruckend! Oder?

Die Funktion funktioniert besonders gut, wenn du nur die Audiospur deiner Videos synchronisieren möchtest! Wenn du viele Videos oder Podcasts hast und diese in mehreren Sprachen anbieten willst, ist ElevenLabs* das KI Tool deiner Wahl!

Und das Beste, ElevenLabs verwendet deine Stimme zum Synchronisieren! Du musst also keine generierte Stimme verwenden, dadurch wirkt deine Stimme auch in anderen Sprachen natürlich!

ElevenLabs* ermöglichst es dir Sprachbarrieren zu überwinden und deinen Content aufs nächste Level zu heben. Starte heute noch durch!